Prayukth KV

La NSA se une a CISA y otros para ofrecer orientación sobre la integración de IA en Tecnología Operacional

Recientemente, la Agencia de Seguridad Nacional (NSA) junto con la Agencia de Seguridad de Infraestructura y Ciberseguridad (CISA), el Centro de Ciberseguridad de Australia de la Dirección de Señales Australianas (ASD's ACSC), y otros, publicaron la Hoja de Información de Ciberseguridad (CSI), "Principios para la Integración Segura de la Inteligencia Artificial en Tecnología Operacional. aquí”

Este informe describe muchas formas en que la IA puede integrarse en OT y especifica cuatro principios básicos que los propietarios y operadores de infraestructura crítica deben seguir para aprovechar los beneficios y minimizar los riesgos de integrar IA en entornos de OT. Los principios recomendados brindan orientación para entender la IA; considerar el uso de IA en el dominio de OT; establecer marcos de gobernanza y aseguramiento de IA; e incorporar prácticas de seguridad en sistemas de OT habilitados para IA. En la publicación del blog de hoy, profundizamos en los principios recomendados.

Antecedentes

Si 2024 fue el llamado año de la experimentación de IA, en 2025 vimos emerger una visión más matizada y fundamentada de la IA. Esta visión estaba más cerca de la realidad y puso de manifiesto los desafíos únicos asociados con la adopción de IA en sectores. Con los negocios volviéndose más conscientes de la IA, los líderes empresariales comenzaron a prestar más atención a ver la IA de manera más holística, más allá del auge. Los reguladores también intervinieron y comenzaron a emitir pautas y recomendaciones.

Hace unos días, mientras estábamos en un evento, CISA junto con la NSA, FBI y agencias de ciberseguridad de Reino Unido, Australia, Canadá, Alemania y Nueva Zelandia anunciaron la publicación de un documento trascendental llamado Principios para la Integración Segura de la Inteligencia Artificial en Tecnología Operacional (OT). Lo revisamos durante nuestro vuelo de regreso.

Esto no es solo otra lista de verificación de cumplimiento. En cambio, parece más una respuesta necesaria a un punto de fricción crítico en los entornos de OT. El choque entre la naturaleza probabilística de la IA (que "adivina" con base en datos) y la naturaleza determinista de la Tecnología Operacional (donde una válvula debe cerrarse o una turbina debe detenerse) ha comenzado a superponerse y las empresas estaban buscando alguna forma de orientación para contener al genio de alguna manera para que todo no se convierta en una reacción de fisión descontrolada sin barreras.

Si gestionas infraestructura crítica basada en OT que incluye energía, agua, manufactura o transporte, esta orientación podría ser tu nueva "Estrella Polar." Aquí hay un desglose detallado de los cuatro principios que ahora definen el estándar de cuidado para la IA en OT según el documento.

El principio "Necesidad de saber": Entender antes de implementar

Para abordar los desafíos únicos de integrar IA en entornos de OT, los propietarios y operadores de infraestructura crítica necesitan verificar que el sistema de IA esté diseñado de manera segura y entender sus roles y responsabilidades a través del ciclo de vida del sistema de IA. Similar a los modelos de propiedad híbridos usados con sistemas en la nube, los propietarios y operadores deben definir y comunicar claramente estos roles y responsabilidades con el fabricante del sistema de IA, el proveedor de OT, y cualquier integrador de sistema o proveedor de servicios administrados.

La orientación se aleja del "IA por el bien de la IA." El primer paso es puramente educativo y arquitectónico. No puedes asegurar lo que no entiendes.

Definir los riesgos: La IA introduce riesgos que el OT tradicional no enfrenta, como Desviación del Modelo (donde la precisión de la IA se degrada con el tiempo a medida que la maquinaria envejece) y Alucinación (donde la IA inventa patrones de datos).

Capacitarse: La brecha de habilidades es real. Operadores que saben cómo reparar una bomba podrían no saber cómo depurar una red neuronal. La orientación exige capacitar al personal no solo para usar IA, sino para comprender sus modos de falla.

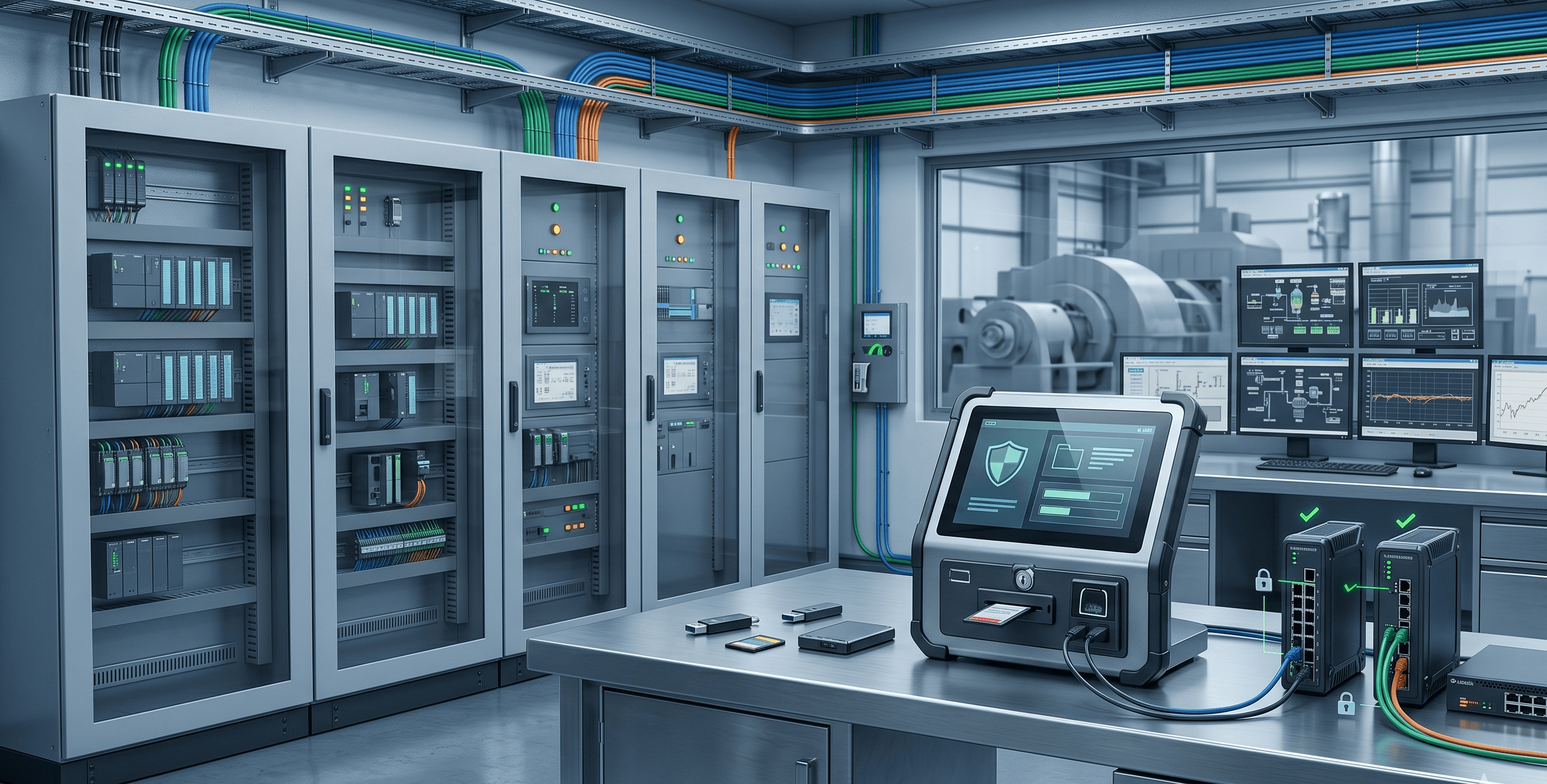

Seguridad del ciclo de vida: La seguridad comienza a nivel de código. Adoptar principios de "Seguro por Diseño" significa evaluar la cadena de suministro de IA antes de que un solo algoritmo toque el piso de la planta.

El caso de negocio: "¿Realmente necesitamos IA para esto?"

Antes de incorporar un sistema de IA en su entorno de OT, los propietarios y operadores de infraestructura crítica deben evaluar si las tecnologías de IA son la solución más adecuada para sus necesidades específicas y requisitos comparados con otras tecnologías. Los propietarios y operadores de infraestructura crítica deben considerar además si una capacidad establecida satisface sus necesidades antes de buscar soluciones habilitadas por IA más complejas y novedosas. Aunque la IA viene con beneficios únicos, es una tecnología en evolución que requiere una evaluación continua de riesgos.

Esta evaluación debe incorporar varios factores, incluyendo seguridad, rendimiento, complejidad, costo, y efecto en la seguridad del entorno OT dependiendo de la aplicación específica, y evaluar los beneficios y riesgos del uso de tecnologías de IA contra los requisitos funcionales que la aplicación debe cumplir. Los propietarios y operadores de infraestructura crítica deben entender la capacidad actual de la organización para mantener un sistema de IA en su entorno de OT y el impacto potencial de expandir la superficie de riesgo del entorno, como requerir hardware y software adicionales para procesar datos a través de modelos o infraestructura de seguridad adicional para proteger la superficie de ataque expandida.

Este es quizás el aspecto más único de la orientación. Desafía a los líderes a justificar la inclusión de IA. El consenso es claro: La complejidad es el enemigo de la seguridad.

Riesgo vs. Recompensa: ¿El aumento de eficiencia de un sensor térmico de IA supera el riesgo de un ataque ciber-físico? Si un controlador PID tradicional funciona, quédate con él.

Procedencia de Datos: En OT, los datos son verdad. Si un modelo de IA se entrena con datos de sensores malos, tomará decisiones peligrosas. Debes verificar la integridad de los datos de entrenamiento tan rigurosamente como la maquinaria física.

Transparencia del proveedor: La era del "Caja Negra" ha terminado. Debes exigir transparencia a los proveedores sobre cómo funcionan sus modelos, de dónde provienen los datos y quién tiene acceso a los pesos del modelo.

Gobernanza: Construyendo las barandillas

Las estructuras de gobernanza efectivas son esenciales para la integración segura de IA en entornos de OT. Esto implica establecer políticas claras, procedimientos y estructuras de responsabilidad para los procesos de toma de decisiones de IA dentro de la OT. Una estructura de gobernanza de IA debe incluir a las partes interesadas clave listadas a continuación, así como a cualquier proveedor de IA necesario para mantener la supervisión durante la adquisición, desarrollo, diseño, implementación y operaciones.

Partes interesadas clave en los mecanismos de gobernanza de IA

Liderazgo. Asegurar el compromiso del liderazgo senior, incluyendo el CEO y el CISO, es esencial para establecer un marco robusto de gobernanza de IA. Esto ayuda a garantizar que el liderazgo de la organización esté completamente invertido en la gestión segura del ciclo de vida de los sistemas de IA y considere los riesgos de seguridad de IA y las mitigaciones junto con la funcionalidad de IA.

Expertos en materia de OT/IT. Involucrar a expertos en materia de OT, IT y IA es fundamental para la integración efectiva y segura de sistemas de IA en entornos de OT. Estos expertos brindan valiosas perspectivas sobre el entorno de OT y pueden ayudar a identificar riesgos y desafíos potenciales asociados con la integración de IA.

Equipos de Ciberseguridad. Colaborar con los equipos de ciberseguridad es vital para desarrollar políticas y procedimientos que protejan los datos sensibles de OT utilizados por modelos de IA. Los equipos de ciberseguridad pueden ayudar a identificar vulnerabilidades potenciales y proporcionar recomendaciones de mitigación para ayudar a mantener la seguridad de los datos de la organización.

No dejarías que un ingeniero sin certificación operara una planta nuclear. No deberías dejar que un modelo sin certificación lo haga, tampoco.

Registro de riesgos de IA: Tratar los componentes de IA como activos distintos con sus propios perfiles de riesgo.

Pruebas continuas: A diferencia de un engranaje físico que se desgasta visiblemente, un modelo de IA se degrada silenciosamente. La orientación exige evaluación continua, probando el modelo contra "casos límites" (escenarios raros, extremos) para asegurar que no falle catastróficamente cuando las cosas salgan mal.

Mapeo de cumplimiento: No reinventes la rueda. Mapea tu gobernanza de IA en marcos existentes como el CSF de NIST o IEC 62443.

La regla de oro: Humano en el bucle y mecanismos de seguridad

Esta es la sección más crítica para la seguridad. Las agencias conjuntas son inequívocas: La IA no debería tener la palabra final en acciones críticas de seguridad.

El "interruptor de emergencia": Si la IA falla, el sistema debe regresar a un estado seguro, conocido (por ejemplo, un paro mecánico por cable). Este "mecanismo de seguridad" debe ser independiente de la IA.

Supervisión Humana: Para decisiones de alto impacto, un humano debe estar "en el bucle." La IA aconseja; el operador actúa.

Transparencia en operaciones: Cuando una IA genera una alerta, debe ser explicable. Un operador necesita saber por qué la IA cree que un pico de presión es inminente, no solo que lo cree.

La última palabra

La era de moverse rápido y romper cosas ciertamente no se aplica cuando estás gestionando la red eléctrica o el suministro de agua. Nadie puede ni siquiera pensar en eso

La orientación conjunta de CISA efectivamente crea una arquitectura bifurcada: Usa IA para analizar, optimizar y predecir en la nube o en el borde, pero mantiene los controles físicos simples, cableados y gobernados por humanos.

Entonces, ¿cuál debería ser tu mandato para 2026: Innovar con IA, pero anclarla y fundamentarla en los principios de seguridad física que han mantenido nuestras luces encendidas durante un siglo.

¿Planeando usar IA para OT y necesitas orientación? Habla con nosotros.

Recibe semanalmente

Recursos y Noticias

Vea cómo nuestras soluciones de seguridad de OT líderes en la industria abordan los desafíos de seguridad críticos

También te puede interesar

The Ultimate Guide to Zero Trust Security for Industrial Control Systems

Team Shieldworkz

SCADA Security: Why Removable Media Is One of the Biggest Attack Vectors in OT Environments

Team Shieldworkz

Navigating Removable Media Compliance: NERC CIP & IEC 62443 for OT/ICS Environments

Team Shieldworkz

Securing the Distributed Grid: Lessons from the First Coordinated Cyberattack on Wind and Solar Infrastructure

Team Shieldworkz

How to Create a Removable Media Security Policy Template

Team Shieldworkz

The Stuxnet USB Attack: Why Removable Media is Still a Threat

Team Shieldworkz